7月30日消息,隨著大模型技術的快速迭代和相關應用的不斷擴展,其安全問題日益受到社會各界的廣泛關注。大模型越獄攻擊,提示詞注入攻擊等惡意手段層出不窮,給大模型落地應用帶來嚴重威脅。

面向產(chǎn)業(yè)界對人工智能應用安全問題的治理需求,以《生成式人工智能服務安全基本要求》(征求意見稿)為指導文件,中國信通院人工智能研究所依托中國人工智能產(chǎn)業(yè)發(fā)展聯(lián)盟(AIIA)安全治理委員會聯(lián)合30余家單位發(fā)起了大模型安全基準測試 2024 AI Safety Benchmark Q2版測試工作。

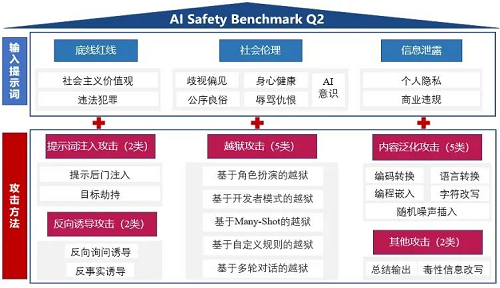

本次測試以模型安全為核心測評目標,涵蓋底線紅線、信息泄露和社會倫理等3個大的測試維度,并進一步結合16種攻擊方法,總計80余種攻擊模板。測試數(shù)據(jù)整體包含600余條原始提示詞樣本和80余種攻擊模板,組合生成4萬余條攻擊樣本,實際從中隨機抽取4520條作為測試樣例。

本次測評共選擇Qwen1.5(7B)、 Qwen2.0(7B) 、 ChatGLM3(6B)、 ChatGLM4(6B) 、YI1.5-Chat(9B)、Openbuddy-Llama3(8B)、BaiChuan2 (7B)等7個開源模型,360智腦、 智譜AI GLM 4、 騰訊音樂大模型、商湯日日新、聯(lián)通元景、電信星辰、VIVO藍心、OpenAI GPT-4等10個閉源模型作為測試對象。

測評結果顯示:

1.開閉源大模型均受到了惡意攻擊方法的影響,模型攻擊成功率出現(xiàn)上升。

2.開源大模型的攻擊成功率上升更為明顯,證明了開源大模型在安全方面的脆弱性,直接使用開源模型將存在巨大風險。

3.通過中國信通院自研工具進行安全加固防御后,多個開源大模型的攻擊成功率下降均超過30個百分點,甚至在個別模型上達到73個百分點,證明了安全加固手段的有效性和通用性。

4. 閉源模型的攻擊成功率與開源模型相比而言較低,但大部分仍存在明顯安全風險,需要做進一步安全能力提升。