隨著人工智能及其在未來扮演的角色成為社會討論的焦點,恩智浦也在探索一個關鍵問題:如何從開發(fā)流程著手,確保人工智能和機器學習的安全?

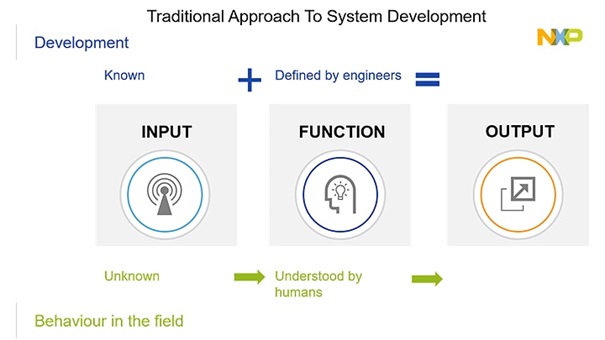

在恩智浦,我們會按照客戶提出的正式要求,為硬件開發(fā)相應的功能。為了滿足客戶的要求,我們首先列出一些已知的輸入信息,也就是用例。用例可能是雷達傳感器在汽車中的位置(面朝前方或角落)、電動汽車電池的工作電壓、汽車駕駛艙內的屏幕數(shù)量等。然后,我們再定義設計,驗證功能是否按照預期方式工作,而且我們不僅在模擬環(huán)境中驗證,還在實地環(huán)境中驗證。在實地環(huán)境中,因為無法控制功能實際接收到的輸入,所以要在選定的用例范圍內,將功能設計得盡可能穩(wěn)定可靠。

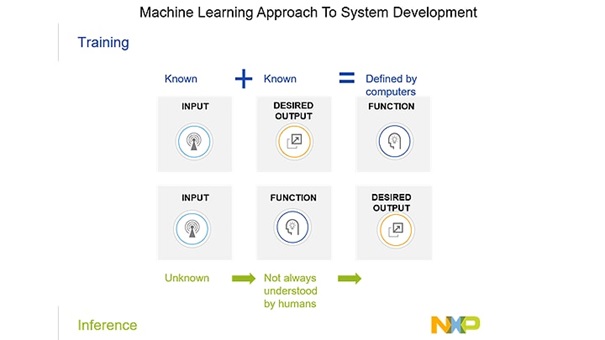

但對于人工智能而言,這個開發(fā)過程會有一點變化。我們仍然會定義用例,但還要為每個用例分配明確定義的輸出。我們會將這個任務交給計算機完成,然后再定義功能。從示例中學習的過程可稱為訓練,我們要教計算機做出我們需要的響應。

一旦對計算機進行了用例訓練,即可將這些知識轉移到設備,讓設備將知識應用于實地環(huán)境,更好地處理難以預知的數(shù)據(jù),這個過程就稱為推理。它與非人工智能流程的關鍵差別在于,在人工智能的開發(fā)中,工程師不一定像過去那樣理解功能本身。

因此我們必須進行評估,調節(jié)機器的行為,直至輸出的結果符合我們最初的預期。對于需要高計算量的設備,這個調節(jié)過程在云端進行,而不是在邊緣進行。

什么是安全的人工智能/機器學習?為什么我們需要它?

人工智能和機器學習將被應用于汽車安全功能,因此必須確保它們不會違反安全規(guī)則。從汽車行業(yè)背景來思考人工智能和機器學習時,汽車OEM面臨的問題是如何了解特定功能的風險級別,以及它們可能對人造成的傷害。因此,在定義功能時,既要避免系統(tǒng)性故障,還要減少隨機故障。我們利用安全管理流程和安全架構來滿足這些要求,從而在由人管理的開發(fā)中,實現(xiàn)設備監(jiān)控。

但是,僅遵循我們現(xiàn)有的開發(fā)流程是不夠的,因為訓練和推理在本質上有所不同。因此,我們需要定義不同的問題陳述。首先,我們必須了解訓練數(shù)據(jù)是否存在系統(tǒng)性故障。其次,我們還必須了解人工智能模型是如何創(chuàng)建的。該模型是否會產(chǎn)生可能導致系統(tǒng)性故障的不必要偏差?此外,在推理過程中,模型的執(zhí)行是否存在隨機故障?

在這一方面,機器學習質保可以發(fā)揮作用,涉及到訓練和評估步驟的完整性、正確性和一致性,涵蓋所有頂級安全流程和數(shù)據(jù)管理,其目的是確保使用的數(shù)據(jù)是正確和完整的,不存在任何偏差。

在推理層面上,安全機制可以確保硬件的完整性,而這些硬件可能是任何形式的硬件內核。經(jīng)典的安全機制具有ECC/奇偶校驗、鎖步和流量監(jiān)控功能。另外,其還能夠利用安全封裝器加以增強,對數(shù)據(jù)進行更多檢查,從統(tǒng)計上衡量安全性能。

恩智浦有關算法道德的白皮書闡述了恩智浦對人工智能開發(fā)完整性的看法,并探討了可靠人工智能的安全性和透明度。我們有一款名為Auto eIQ的專用軟件,可幫助開發(fā)人員評估和優(yōu)化訓練模型,并將訓練模型部署到目標環(huán)境中,幫助我們持續(xù)提高模型的可靠性。

作者簡介:

Andres Barrilado

恩智浦半導體功能安全評估員

Andres在恩智浦核心團隊中擔任功能安全評估員。過去,Andres還曾經(jīng)擔任雷達前端設備的安全架構師,以及汽車傳感器的應用工程師。