6 月 17 日消息,最新研究稱,越來越多的人難以在圖靈測(cè)試中區(qū)分 GPT-4 和人類。

" 圖靈測(cè)試 " 由計(jì)算機(jī)科學(xué)家艾倫?圖靈在 1950 年提出,又被稱為 " 模仿游戲 "。測(cè)試的標(biāo)準(zhǔn)是機(jī)器能否像人類一樣進(jìn)行對(duì)話,讓對(duì)方誤以為其是真人。

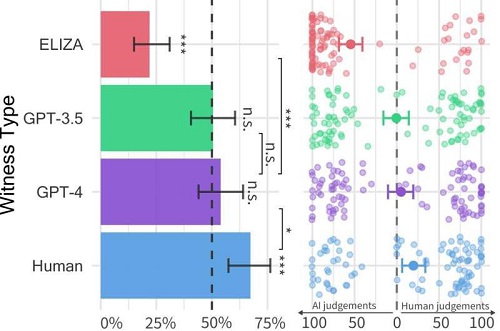

加州大學(xué)圣地亞哥分校的研究人員招募了 500 名參與者,讓他們與四位 " 對(duì)話者 " 進(jìn)行五分鐘的交流,這四位 " 對(duì)話者 " 分別是真人、上世紀(jì) 60 年代的初代聊天機(jī)器人 ELIZA、以及驅(qū)動(dòng)聊天機(jī)器人 ChatGPT 的 GPT-3.5 和 GPT-4。參與者在對(duì)話結(jié)束后需判斷對(duì)方是人還是機(jī)器。

這項(xiàng)測(cè)試的結(jié)果發(fā)表于預(yù)印網(wǎng)站 arXiv 上,結(jié)果顯示,有 54% 的參與者將 GPT-4 誤認(rèn)為真人。相比之下,預(yù)先設(shè)定好回復(fù)的 ELIZA 只有 22% 的人將其認(rèn)作真人,GPT-3.5 則為 50%,而人類對(duì)話者被正確辨認(rèn)的比例則為 67%。

研究人員指出,圖靈測(cè)試過于簡(jiǎn)單,對(duì)話的風(fēng)格和情感因素在測(cè)試中扮演著比傳統(tǒng)智能認(rèn)知更重要的角色。

電氣和電子工程師協(xié)會(huì) ( IEEE ) 的人工智能研究員內(nèi)爾?沃森 ( Nell Watson ) 表示,單純的智力并不能代表一切,真正重要的是足夠智能地理解情境、他人的技能并具備同理心將這些要素結(jié)合起來。能力僅僅是 AI 價(jià)值的一部分,理解人類的價(jià)值觀、偏好和界限也同樣重要,正是這些品質(zhì)才能讓 AI 成為我們生活中忠誠(chéng)可靠的管家。

沃森還提到,這項(xiàng)研究對(duì)未來的人機(jī)交互提出了挑戰(zhàn),人們將會(huì)對(duì)互動(dòng)對(duì)象的真實(shí)性愈發(fā)疑慮,尤其是在涉及敏感話題時(shí)。同時(shí),這項(xiàng)研究也凸顯了 GPT 時(shí)代人工智能的巨大進(jìn)步。